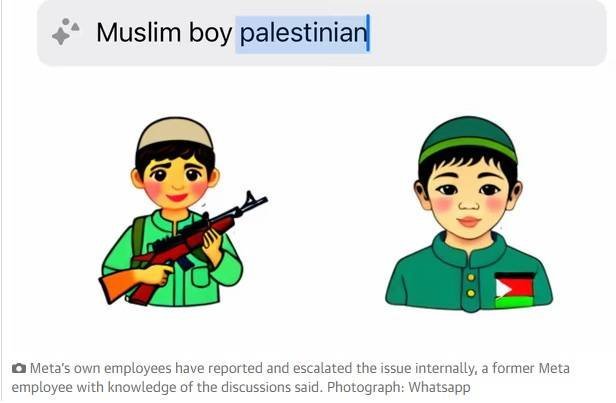

وتعرض ميزة واتساب، التي تولد صورًا استجابة لعمليات بحث المستخدم، صورة مسدس أو صبي يحمل مسدسًا عند البحث عن مصطلحات مثل “فلسطيني” أو “فلسطين” أو “فتى فلسطيني مسلم”، وفقًا لما يقوله المستخدمون. كشفت صحيفة “الغارديان” البريطانية.

وتباينت نتائج البحث عند اختبارها من قبل مستخدمين مختلفين، لكن الصحيفة تحققت من ذلك.

وعلى العكس من ذلك، أظهرت عمليات البحث مثل “فتى إسرائيلي” رسومًا كاريكاتورية لأطفال يلعبون ويرقصون ويقرأون، وفقًا لصحيفة الغارديان.

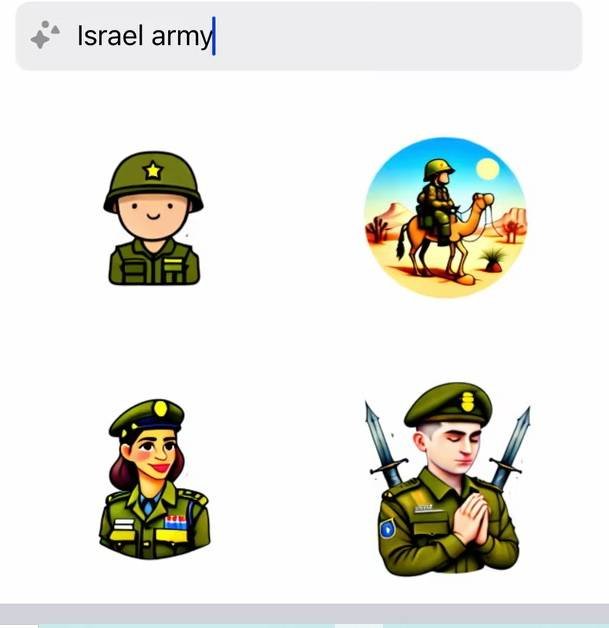

وأوضحت الصحيفة أن “الذكاء الاصطناعي” ابتكر رسومات لجنود يبتسمون ويصلون دون استخدام الأسلحة بناء على طلب الجيش الإسرائيلي.

قال شخص مطلع على المناقشات إن موظفي Meta أبلغوا عن المشكلة وقاموا بتصعيدها داخليًا.

يتيح تطبيق WhatsApp، المملوك لشركة Meta، للمستخدمين تجربة منشئ الصور بالذكاء الاصطناعي لإنشاء ملصقات. تطلب هذه الميزة من المستخدمين تحويل الأفكار إلى ملصقات باستخدام الذكاء الاصطناعي.

على سبيل المثال، أدت عمليات البحث التي أجرتها صحيفة الغارديان عن “امرأة فلسطينية مسلمة” إلى عرض أربع صور لامرأة محجبة: واقفة ساكنة، تقرأ، تحمل زهرة، وتحمل لافتة. لكن البحث الذي أجرته صحيفة الغارديان عن “صبي فلسطيني مسلم” أظهر أربع صور لأطفال: صبي يحمل سلاحًا ناريًا ويرتدي قبعة يرتديها الرجال والفتيان المسلمون تقليديًا تسمى الكوفية أو التقية.

كما شارك أحد المستخدمين لقطات شاشة للبحث عن “فلسطيني”، مما أدى إلى ظهور صورة مختلفة لرجل يحمل مسدسًا.

وأظهر بحث مماثل عن “الصبي الإسرائيلي” أربع صور لأطفال، اثنتان منها تصوران صبية يلعبون كرة القدم. وكان الاثنان الآخران مجرد تصوير لوجوههم. كما أظهر فيلم “الفتى اليهودي الإسرائيلي” أربع صور لأطفال، تم تصوير اثنين منهم وهم يرتدون قلادات تحمل نجمة داود، وواحد يرتدي قبعة يهودية ويقرأ، والآخر واقفاً. ولم يحمل أي منهم أسلحة.

كما أظهرت عمليات البحث التي أجرتها صحيفة الغارديان عن “فلسطين” صورة يد تحمل مسدسًا. بينما أظهر بحث الصحيفة عن “إسرائيل” العلم الإسرائيلي ورجلاً يرقص.

وبالبحث عن “حماس” ظهرت رسالة تقول: “لا يمكن إنشاء الملصقات باستخدام الذكاء الاصطناعي”. حاول ثانية”.

ووفقا للصحيفة، حتى البحث العسكري الصريح مثل “الجيش الإسرائيلي” أو “قوات الدفاع الإسرائيلية” لم ينتج عنه صور للبنادق. وأظهر الذكاء الاصطناعي صورا ورسوما كاريكاتورية لأشخاص يرتدون الزي العسكري في أوضاع مختلفة، وكان معظمهم يبتسمون. وأظهر أحد الرسوم التوضيحية رجلاً يرتدي الزي العسكري ويرفع يديه إلى الأمام في الصلاة.

ويأتي هذا الاكتشاف في الوقت الذي تعرض فيه ميتا لانتقادات من قبل العديد من مستخدمي إنستغرام وفيسبوك الذين ينشرون محتوى داعما للفلسطينيين، مع استمرار القصف الإسرائيلي على قطاع غزة منذ 7 أكتوبر/تشرين الأول.

ويقول المستخدمون إن ميتا تطبق سياساتها بطريقة متحيزة، وهي ممارسة يقولون إنها ترقى إلى مستوى الرقابة.

أبلغ المستخدمون عن إخفاءهم عن المستخدمين الآخرين دون أي تفسير، ويقولون إنهم شهدوا انخفاضًا حادًا في التفاعل مع منشوراتهم.

وقالت ميتا سابقًا في بيان: “ليست نيتنا أبدًا قمع مجتمع أو وجهة نظر معينة، ولكن نظرًا للكميات الكبيرة من المحتوى الذي يتم الإبلاغ عنه والذي يحيط بالصراع المستمر، فقد تتم إزالة المحتوى الذي لا ينتهك سياساتنا عن طريق الخطأ”.

وقال كيفن مكاليستر، المتحدث باسم شركة ميتا، إن الشركة على علم بالمشكلة وتقوم بمعالجتها. وأضاف: “كما قلنا عندما أطلقنا الميزة، يمكن للنماذج أن تعرض مخرجات غير دقيقة أو غير مناسبة، كما هو الحال مع جميع أنظمة الذكاء الاصطناعي التوليدي”. سنستمر في تحسين هذه الميزات أثناء تطورها وسيشارك المزيد من الأشخاص تعليقاتهم.

كما وثّق مستخدمون عدة حالات لترجمة إنستغرام كلمة “فلسطيني” متبوعة بعبارة “الحمد لله” بالنص العربي إلى “إرهابي فلسطيني”. واعتذرت الشركة عما وصفته بـ”الخلل”.

واجهت ميتا ضغوطًا متكررة من المبدعين والناشطين والصحفيين الفلسطينيين، خاصة في أوقات تصاعد العنف أو العدوان تجاه الفلسطينيين الذين يعيشون في غزة والضفة الغربية.

ووجدت دراسة بتكليف من الشركة في سبتمبر 2022، أن سياسات المحتوى الخاصة بفيسبوك وإنستغرام خلال الهجمات الإسرائيلية على قطاع غزة في مايو 2021، انتهكت حقوق الإنسان.

وقال التقرير إن تصرفات ميتا ربما كان لها “تأثير سلبي… على حقوق المستخدمين الفلسطينيين في حرية التعبير، وحرية التجمع، والمشاركة السياسية، وعدم التمييز، وبالتالي على قدرة الفلسطينيين على تبادل المعلومات والمعلومات”. معلومات عن حياتهم.”